著者プロフィール:らくあ|allowsAI編集長

最終更新日:2026年2月20日

文系でも30分でできた!Dify×Ollamaで「自分専用AIアプリ」を作る完全ガイド【2026年版】

「ChatGPTに月20ドル払い続けているけど、本当にこれで良いのか?」「自社の情報をAIに投げるのがセキュリティ的に怖い」——そんな悩みを抱えている人に、今すぐ知ってほしいツールがあります。

それがDifyです。DifyはオープンソースのAIアプリ開発プラットフォームで、プログラミング不要で自分専用のAIチャットボットやワークフローを構築できます。さらにOllamaというローカルLLMツールと組み合わせると、月額ゼロ円・情報漏洩リスクゼロで、ChatGPTに匹敵するAIアプリが手元で動くようになります。

私はEC事業を運営しながら、2025年11月からDifyとOllamaを実務で使い込んできました。最初は「難しそう」と思っていましたが、実際にセットアップしてみると30分もかかりませんでした。この記事では、その手順と実務での活用事例を、できる限り具体的に紹介します。

【結論を先に言うと】

- Dify×Ollamaは「プログラミング不要・月額ゼロ・情報漏洩リスクゼロ」の三拍子が揃った最強の組み合わせ

- ローカルPCでも動くが、チームで使うならエックスサーバーVPSに立てるのが最もコスパが良い

- 「ローカルで試してVPSに移行」よりも、最初からVPSで始める方が挫折率が低い

- EC事業での顧客対応・社内FAQ・商品説明文生成など、実務に即使える活用事例が豊富にある

この記事では、環境構築の手順から実際に作ったAIアプリの中身まで、余すことなく公開します。

検証環境

- 検証期間:2025年11月〜2026年2月(3ヶ月間)

- 利用環境:MacBook Pro(M2・メモリ16GB)+エックスサーバーVPS(4GBプラン)

- 使用用途:顧客対応メール分類、社内FAQ検索、商品説明文生成

- 使用頻度:平日ほぼ毎日

そもそもDifyとは?ChatGPTとの決定的な違い

Difyは「AIを自分のものにする」ためのプラットフォーム

ChatGPTはOpenAIのサーバー上で動くAIです。便利ですが、「入力した情報が学習データに使われるかもしれない」「月額費用がかかり続ける」「自社の業務フローに合わせたカスタマイズができない」という制約があります。

一方、Difyはオープンソースで公開されているAIアプリ開発プラットフォームです。自分のPC(またはサーバー)上にインストールして使うため、入力した情報が外部に送られることはありません。また、チャットボット・文章生成・RAG(社内文書検索)・ワークフロー自動化など、さまざまなAIアプリをノーコードで作れます。

さらに重要なのが、Dify単体ではAIのモデル自体は含まれていない点です。ChatGPT APIやClaude APIを接続して使うこともできますが、今回紹介するOllamaと組み合わせれば、API費用ゼロでローカルのAIモデルを動かせます。

| 項目 | ChatGPT | Dify |

|---|---|---|

| 月額費用 | 月20ドル | 月2,200円〜 |

| データ保存 | OpenAIのサーバー | 自分のPC/サーバー |

| カスタマイズ | 基本的に不可 | モデル変更・プロンプト自由 |

| 利用人数 | 1人のみ | チーム全員で共有可能 |

| セキュリティ | データが外部送信される | 外部に一切出ない |

クラウド版 vs ローカル版、どちらを選ぶべきか

| 項目 | クラウド版 | セルフホスト版 |

| 料金 | 有料プラン:月200ドル〜 | VPS代のみ月2,200円〜 |

| メッセージ制限 | 有料:無制限 | 完全無制限 |

| 機能制限 | 一部機能が有料プランのみ | 全機能が使える |

| データ保存先 | Difyのサーバー(海外) | 自分のPC/VPS |

| セットアップ | アカウント登録のみ | Docker環境の構築が必要 |

| おすすめな人 | まず試してみたい人 | 本格運用したい人/チーム利用 |

ローカルLLMを使うメリット3つ

ローカルLLMとは、インターネットに接続せず自分のPC(またはサーバー)上で動くAIモデルのことです。Ollamaはそのローカルモデルを手軽に管理・実行できるツールで、LLaMA 3、Gemma 3、Qwen2.5など人気モデルを1コマンドでインストールできます。

ローカルLLMを使う主なメリットは3つあります。まずコスト面:APIの従量課金が一切かかりません。大量に使っても月額ゼロです。次にセキュリティ面:顧客情報や社外秘の資料をAIに投げても、データが外部サーバーに送られることがありません。最後にカスタマイズ性:モデルを自社用途に特化したものに差し替えたり、複数モデルを使い分けたりが自由にできます。

【環境構築】Dify×Ollamaを30分でセットアップする手順

必要なもの(PCスペック・ソフトウェア)

まず動作環境の確認です。ローカルPCで動かす場合は以下が目安になります。

- RAM:最低8GB、推奨16GB以上(モデルによって異なる)

- ストレージ:空き容量20GB以上(モデルのサイズが数GB〜数十GBある)

- OS:macOS、Windows、Linux いずれも対応

- 必須ソフト:Docker Desktop、Git

「PCのスペックが心配」「常時稼働させたい」「チームで共有したい」という場合は、後述するVPS利用がおすすめです。ローカル環境と比較して安定性が段違いに上がります。

「PCを常時起動できない」「最初からチームで使いたい」という方は、Difyを自動構築できるエックスサーバーVPSを利用するのが最も簡単です。コマンド操作すら不要で、申し込み時に「Dify」を選ぶだけで環境が完成します。

STEP1:Docker Desktopのインストール

DifyはDockerというコンテナ技術を使って動きます。まずDocker Desktopの公式サイト(docker.com)からインストーラーをダウンロードし、指示に従ってインストールしてください。Macであれば「Mac with Apple Silicon」または「Mac with Intel chip」を選んでダウンロードします。インストール後、Docker Desktopを起動してクジラのアイコンがメニューバーに表示されればOKです。

STEP2:DifyをDockerで立ち上げる(コマンド3行)

ターミナル(Macならターミナル.app、WindowsならPowerShell)を開いて、以下の3行を順番に実行するだけです。

git clone https://github.com/langgenius/dify.git

cd dify/docker

docker compose up -d最初の実行時は必要なファイルのダウンロードが走るので5〜10分かかります。完了したらブラウザで http://localhost/install にアクセスしてください。管理者アカウントの設定画面が表示されれば成功です。

STEP3:Ollamaのインストールと日本語対応モデルの導入

Ollama公式サイト(ollama.com)からインストーラーをダウンロードしてインストールします。インストール後、ターミナルで以下を実行すると日本語に対応したモデルがダウンロードされます。

ollama pull qwen2.5:7b日本語用途では現時点でQwen2.5(7Bまたは14B)が最もバランスが良いです。7Bモデルならファイルサイズが約4.7GBで、16GBのRAMがあれば快適に動きます。他にも llama3.2(英語特化)や gemma3 なども選択肢に入ります。

STEP4:DifyとOllamaを接続する(ハマりやすいポイントも解説)

Difyの管理画面から「設定」→「モデルプロバイダー」→「Ollama」を選択します。接続先URLの設定でハマりやすいポイントがあります。

ローカルPCで動かしている場合、DifyはDocker内で動いているため、接続先は http://localhost:11434 ではなく http://host.docker.internal:11434 と入力する必要があります。ここを間違えると接続エラーになるので注意してください。

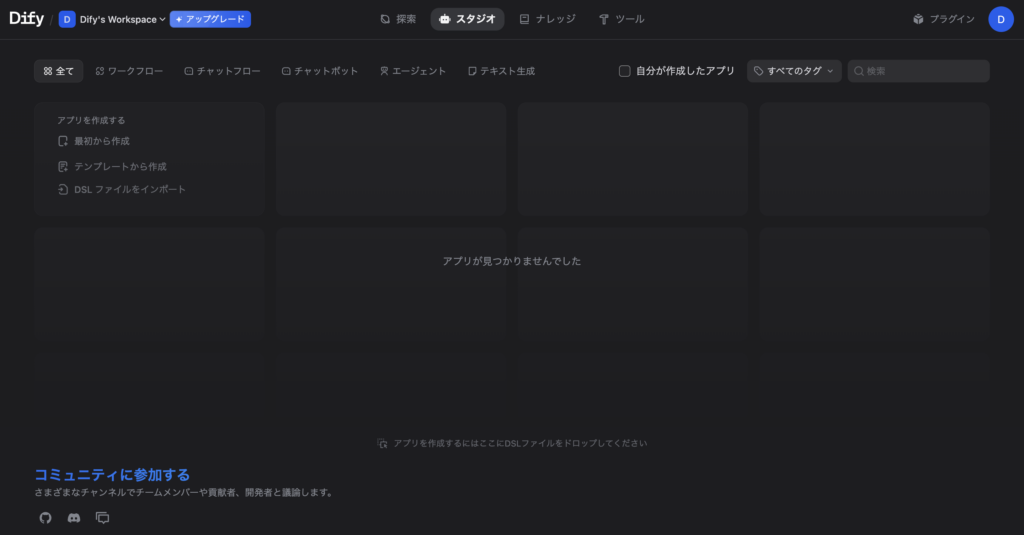

接続テストが成功すると、Difyのアプリ作成画面でOllamaのモデルが選択できるようになります。これで環境構築は完了です。

【実践】EC事業者が実際に作った3つのAIアプリ

環境が整ったら、次は実際にアプリを作ってみましょう。私がEC事業で実際に使っている3つのアプリを紹介します。

①顧客メール自動分類ボット(英語→日本語翻訳+カテゴリ付け)

海外からの英語問い合わせメールを受け取るたびに「返品?配送?それとも商品の質問?」と内容を読んで分類する作業が毎日発生していました。1件5分、1日10件で50分のロスです。

DifyでチャットボットアプリのSystemプロンプトに「以下のメール文を読み、①日本語に要約、②カテゴリ(返品/配送/商品問い合わせ/その他)を判定、③緊急度(高/中/低)を判定して出力してください」と設定するだけで完成します。所要時間は設定から完成まで約10分でした。

結果、1件あたりの処理時間が5分から30秒に短縮されました。1日換算で約40分の削減、月換算では約14時間の時短です。

②社内FAQ検索AI(過去の議事録・マニュアルをRAGで検索)

「あの返品対応のルールってどこに書いてあったっけ?」「新しいスタッフが入るたびにマニュアルの場所を聞かれる」——これを解決したのがDifyのRAG(Retrieval-Augmented Generation)機能です。

DifyのKnowledgebase(ナレッジベース)機能に、社内マニュアルや議事録のPDF・テキストファイルをアップロードするだけで、自動的にベクトルデータベースが構築されます。あとは「このナレッジベースを参照して回答して」とアプリに設定するだけで、社内文書に特化した検索AIができあがります。

「返品対応の手順を教えて」と質問すると、マニュアルの該当箇所を引用しながら回答してくれます。これはChatGPT単体では絶対にできない機能です。

③商品説明文生成ツール(テンプレ×AIで量産)

ECサイトに新商品を登録するたびに商品説明文を書くのは地味に時間がかかります。Difyのワークフロー機能を使うと、「商品名」「特徴(箇条書き)」「ターゲット」を入力するだけで、ECサイト用の商品説明文を自動生成するツールが作れます。

自社のトーン・マナーをSystemプロンプトに埋め込んでおけば、毎回同じ文体・品質の説明文が出力されます。外注していたライティング費用が大幅に削減できた案件でもあります。

VPSを使えばチームで共有できる「社内AI基盤」になる

ローカルPCの限界とVPSという選択肢

ローカルPCでDifyを動かす場合、いくつかの制約があります。まずPCの電源を切るとAIが止まるという問題です。外出中や夜間はアクセスできません。次にチームメンバーが使えないという問題。自分のPCで動かしている以上、他の人はアクセスできません。さらに重い処理でPCが遅くなることもあります。ローカルLLMはCPU・メモリを大量に使うため、作業中の別の処理に影響が出ます。

これらの問題を一気に解決するのがVPS(仮想専用サーバー)の活用です。VPSにDifyを立てれば、24時間365日稼働し続け、チームメンバーもブラウザからアクセスできる「社内AI基盤」が完成します。

エックスサーバーVPSでDifyを動かすコスパ

VPSの選択肢はいくつかありますが、エックスサーバーVPSがDifyとの相性が良くておすすめです。理由は、Difyのアプリイメージが公式に用意されており、サーバー申し込み時にDifyを選択するだけで環境が自動構築されるからです。コマンドを叩く必要すらありません。

通常、VPSにDifyを入れるには黒い画面(Linuxコマンド)との格闘が必要です。しかし、エックスサーバーVPSなら「Difyアプリイメージ」を選ぶだけで、全自動で環境が完成します。文系や非エンジニアが挫折しないための最強の機能です。Docker、Git、SSL証明書の設定——これらすべてが最初から完了した状態で納品されるため、「コマンドが怖い」という人でも安心して使えます。

料金は6GBプランで月額2,000円程度(キャンペーン価格あり)ChatGPT Plus(月20ドル=約3,000円)と比べても安く、しかも複数人で使い回せるため、チーム3人以上なら確実に元が取れます。

エックスサーバーVPSでDify環境を立てる手順はこちら:

- エックスサーバーVPSのお申し込みページからプランを選択(4GBプラン以上を選ぶこと)

- 「アプリケーションイメージ」から「Dify」を選択

- 10分ほどでサーバーが立ち上がり、DifyのURLが発行される

- 発行されたURLにアクセスして管理者アカウントを設定すれば完了

「ローカルで試してみて良かったから、本番環境に移行したい」という人にも、この手順は最もスムーズです。

Difyのデメリット・注意点(正直に話す)

PCスペックへの依存度が高い

ローカルで動かす場合、使用するLLMモデルのサイズによって必要なメモリが変わります。7Bモデルなら8GB以上のRAMが必要で、14Bモデルになると16GB以上が求められます。古いPCや低スペックのマシンでは動作が重くなる、またはそもそも動かないケースがあります。

この問題の解決策は前述のVPS利用です。スペックの高いVPSを月額費用で借りる方が、PCを買い替えるよりもコスパが良い場面も多いです。

日本語の精度はモデル次第

正直に言うと、ChatGPT-4oと比べると日本語の自然さや論理展開の精度は一段落ちます。特に複雑な文章の生成や高度な推論が必要な場面では差が出ます。日本語で使うならQwen2.5が現時点で最も優れていますが、それでもGPT-4oには劣ります。

ただし、定型業務(メール分類・要約・FAQ検索など)においては十分な精度が出ます。「なんでもこなせる万能AI」というよりも「特定業務に特化した業務自動化ツール」として捉えると、不満は感じにくいです。

クラウド版との機能差

セルフホスト版はアップデートを自分で適用する必要があります。Difyは開発が活発で頻繁に新機能が追加されていますが、クラウド版と比べると最新機能の反映が遅れることがあります。また、バックアップの管理も自己責任です。VPSで運用する場合は定期バックアップの設定を忘れずに行ってください。

【おまけ】ブログやWebサイトの基盤にはレンタルサーバーがおすすめ

ここまでVPSの話をしてきましたが、「DifyやLLMは使わないけど、ブログやECサイトを始めたい」という人にはレンタルサーバーの方が適しています。VPSはサーバーの設定をある程度自分で行う必要がありますが、レンタルサーバーはWordPressのインストールなどが1クリックでできるため、初心者でも安心です。

エックスサーバーのレンタルサーバーは国内シェアNo.1で、表示速度・サポート体制ともに安定しています。このブログ(allowsAI)もエックスサーバーで動かしています。

よくある質問(FAQ)

- Difyは完全無料で使える?

-

セルフホスト版であれば完全無料です。OSSライセンスで公開されており、商用利用も可能です。ただし、VPSなどのサーバー費用は別途かかります。クラウド版(dify.ai)にも無料プランがありますが、メッセージ数の上限や機能制限があるため、本格的に使うならセルフホスト版が推奨です。

- Ollamaのモデルはどれを選べばいい?

-

日本語用途ならQwen2.5:7b(RAM 8GB以上)またはQwen2.5:14b(RAM 16GB以上)が現時点でベストです。英語メインならllama3.2:3b(RAM 4GB〜)が軽くて使いやすいです。まずはQwen2.5:7bから試してみて、処理速度や精度が不満なら上位モデルに変更する流れがおすすめです。

- セキュリティ面は本当に大丈夫?

-

ローカルまたはVPS上で動かしている限り、入力したデータがOpenAIやGoogleのサーバーに送られることはありません。ただし、VPS上で動かす場合はSSL設定やファイアウォールの設定が必要です。エックスサーバーVPSのDifyイメージはSSLが自動設定されるため、この点で安心して使えます。社内の機密情報を扱う場合でも、適切に設定すれば十分に安全です。

- VPSとローカルPC、どちらがおすすめ?

-

個人で試すだけならローカルPCで十分です。ただし、チームで使いたい・常時稼働させたい・PCのスペックが低いという場合はVPS一択です。エックスサーバーVPSならDifyの自動セットアップ機能があるため、技術的なハードルが低く、初心者でも導入しやすいです。

- ChatGPT APIと比べてどちらが賢い?

-

汎用的な文章生成や複雑な推論ではChatGPT API(GPT-4o)の方が優れています。ただし、社内文書の検索や定型業務の自動化など特定用途に絞れば、ローカルLLMでも十分な精度が出ます。「コストゼロ・情報漏洩リスクゼロ」を優先するならローカルLLM、最高精度を優先するならChatGPT APIという使い分けがおすすめです。なお、DifyはChatGPT APIとの接続にも対応しているため、用途によって切り替えることもできます。

- プログラミングの知識は必要?

-

基本的な操作はほぼ不要です。Dockerのインストールとターミナルでのコマンド3行入力ができれば環境構築は完了します。エックスサーバーVPSを使えばコマンド操作すら不要です。アプリの作成もGUI(画面操作)で完結するため、文系の方でも問題なく使えます。

- エックスサーバーVPSの月額料金はいくら?

-

4GBプラン(Dify推奨)で月額2,200円〜です。ChatGPT Plus(月20ドル≒3,000円)より安く、複数人で使えるため、3人以上のチームなら1人あたり月733円という圧倒的コスパです。初期費用無料、最低利用期間なしなので、1ヶ月だけ試すこともできます。

まとめ「AIを所有する時代」が来た

Dify×Ollamaという組み合わせは、これまで大企業や技術者だけが構築できた「自社専用のAIシステム」を、個人事業主や中小企業でも持てる時代が来たことを象徴しています。月額ゼロ円、情報漏洩リスクゼロ、プログラミング不要——3ヶ月使い込んだ実感として、これは本当に「使える」ツールです。

- まずローカルで試したい → この記事のSTEP1〜4をそのまま実行してみてください

- チームで本格運用したい → エックスサーバーVPSのDifyイメージが最速・最安

- ブログやWebサイトの基盤を作りたい → エックスサーバー(レンタルサーバー)がおすすめ

「AIを使う側」から「AIを持つ側」へ。Difyはそのための最もシンプルな入り口です。ぜひ試してみてください。

▼ エックスサーバーVPS(Dify自動セットアップ対応)

\ コマンド不要!Dify自動セットアップ対応 /

参考リンク:

- Dify公式サイト:https://dify.ai

- Dify GitHubリポジトリ:https://github.com/langgenius/dify

- Ollama公式サイト:https://ollama.com